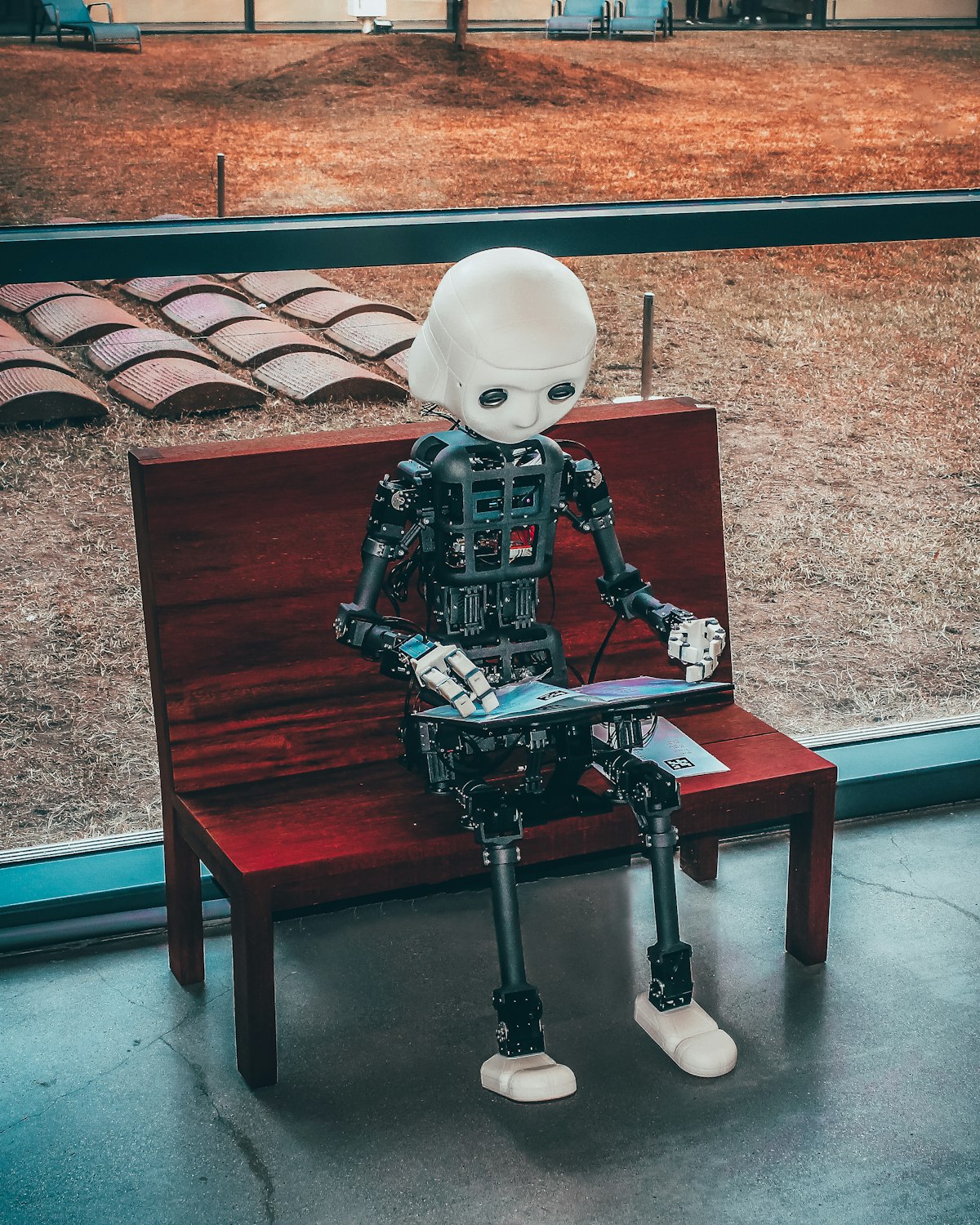

O universo da inteligência artificial, com suas promessas de inovação e transformação, muitas vezes parece ser um palco onde apenas algoritmos complexos e avanços tecnológicos brilham. No entanto, por trás de cada linha de código e de cada modelo revolucionário, existem equipes de pessoas, com suas interações, ambições e, por vezes, conflitos que moldam – e até mesmo abalam – o futuro de empresas gigantes e, por extensão, de todo o setor.

Recentemente, os bastidores da OpenAI, uma das organizações mais influentes no desenvolvimento da IA, vieram à tona de uma forma dramática. Em meio a um processo judicial que envolveu o cofundador bilionário Elon Musk, o atual CEO da OpenAI, Sam Altman, fez revelações contundentes sobre os primeiros anos da empresa, apontando para o que ele descreveu como um “enorme dano” à cultura organizacional causado pelas táticas e exigências de Musk. Esse episódio não é apenas uma fofoca corporativa; é um alerta sobre a importância da cultura em ambientes de alta inovação e o impacto que personalidades fortes podem ter.

A Tensão nos Primórdios da OpenAI: Métodos e Consequências

O depoimento de Sam Altman lança luz sobre um período turbulento nos primórdios da OpenAI, quando Elon Musk ainda exercia influência significativa. Segundo Altman, Musk teria exigido que líderes como o presidente Greg Brockman e o ex-cientista-chefe Ilya Sutskever implementassem um sistema de classificação implacável para os pesquisadores, onde a produtividade e as realizações seriam avaliadas de forma extremamente dura. A metáfora utilizada para descrever a intensidade dessa demanda – algo como “passar uma motosserra” nos quadros – sugere uma pressão descomunal e uma cultura de meritocracia agressiva que visava a eliminação dos menos “produtivos”.

Essa abordagem, embora vista por alguns como uma forma de impulsionar a excelência, pode ter um custo humano altíssimo. Em um campo tão colaborativo e que exige criatividade e experimentação como a IA, um ambiente de avaliação tão punitivo pode sufocar a inovação, gerar medo, inibir a troca de ideias e, em última instância, provocar uma fuga de talentos. O “dano cultural” mencionado por Altman indica que a busca por resultados a qualquer custo pode corroer o espírito de equipe e a confiança, elementos essenciais para o avanço em frentes tão complexas e desafiadoras quanto a inteligência artificial.

Cultura Empresarial e o Futuro da Inovação em IA

O caso OpenAI-Musk-Altman serve como um poderoso lembrete de que o sucesso de uma empresa de tecnologia, especialmente na vanguarda da IA, não depende apenas da capacidade técnica de seus engenheiros ou do brilho de seus fundadores. A cultura organizacional é um pilar fundamental. Um ambiente que valoriza a colaboração, o bem-estar dos funcionários, a liberdade para experimentar e falhar (e aprender com isso) tende a ser mais fértil para a inovação de longo prazo.

Em contraste, uma cultura de medo, competição interna excessiva e pressão constante por resultados imediatos pode levar ao esgotamento profissional, à estagnação criativa e até mesmo a atalhos éticos. No desenvolvimento de IA, onde questões de viés, privacidade e impacto social são cruciais, uma cultura que prioriza apenas a velocidade e a “performance” sem considerações humanas pode ter consequências graves não apenas para a empresa, mas para a sociedade como um todo. A criação de IA responsável e benéfica exige uma equipe alinhada em valores e motivada por um propósito que vai além dos gráficos de desempenho.

O Impacto e as Lições para o Ecossistema Brasileiro de IA

As turbulências nos bastidores de gigantes como a OpenAI ressoam em todo o mundo, inclusive no Brasil. Nosso ecossistema de inteligência artificial, embora em crescimento, é ainda incipiente se comparado aos grandes polos globais. As lições desse episódio são valiosas para as startups, centros de pesquisa e grandes empresas brasileiras que estão apostando na IA.

Primeiro, destaca a necessidade de construir culturas corporativas robustas e humanas desde o início. Empresas brasileiras de tecnologia, como algumas fintechs e healthtechs que estão implementando IA, devem focar em ambientes que atraiam e retenham talentos, valorizando a diversidade, a colaboração e o bem-estar. A “síndrome do vira-lata”, que por vezes nos faz duvidar do nosso próprio potencial, pode ser combatida com a construção de ambientes onde a inovação local seja valorizada e nutrida.

Segundo, a pressão por resultados deve ser equilibrada com a ética e a sustentabilidade. À medida que o Brasil busca regular a IA, discussões sobre responsabilidade e impacto social se tornam cada vez mais pertinentes. Uma cultura empresarial que negligencia esses aspectos em prol de um crescimento desenfreado pode gerar problemas éticos e legais significativos. Precisamos fomentar um ambiente onde a excelência técnica caminhe lado a lado com a responsabilidade social.

O Futuro da IA no Brasil: Construindo sobre Bases Sólidas

O episódio envolvendo Sam Altman e Elon Musk na OpenAI é um lembrete vívido de que a jornada da inteligência artificial é tão humana quanto tecnológica. Para o Brasil, com seu imenso potencial em talento e desafios únicos que podem ser resolvidos com a IA, é crucial que aprendamos com essas experiências internacionais.

O futuro da IA no Brasil não será determinado apenas pela quantidade de investimento ou pelo número de artigos científicos publicados, mas fundamentalmente pela qualidade de nossas culturas organizacionais. Precisamos de empresas que inspirem e capacitem seus colaboradores, que promovam um ambiente de inovação colaborativa e que priorizem a ética e o impacto positivo. Ao construir sobre essas bases sólidas, o Brasil tem a oportunidade de não apenas acompanhar o ritmo global da IA, mas de se tornar um protagonista, desenvolvendo soluções que reflitam nossos valores e atendam às nossas necessidades, mostrando que a excelência tecnológica e a humanidade podem, e devem, caminhar juntas.